ニュース

事故も想定、検証しやすく…産総研が策定した「生成AI」

品質管理指針の特徴

2025.08.26

事故も想定、検証しやすく

産業技術総合研究所が生成AI(人工知能)の品質マネジメントガイドラインを策定した。特徴は品質管理の方法論を採用した点だ。AIシステムの用途ごとに要件を定義して必要な品質を作り込む。公平などの数値化の難しい課題を発注者と開発者で検討するためのたたき台になる。同時にガイドライン自体は事故時の免罪符にはならない。あくまでもAI品質を作り込む過程を通して説明責任を果たす仕組みを構築する。(小寺貴之)

「AIに100%はない。事故は起き得る前提でどのようにコントロールするか。そのプロセスが重要」と産総研の妹尾義樹標準化オフィサー・AI品質マネジメントイニシアティブ(AIQMI)会長は強調する。

生成AIはコードや画像の生成などさまざまな用途に応用されている。ただハルシネーション(誤情報生成)を起こしたり、学習データのバイアスが差別的な情報を生成したりと扱いが難しい。そこで生成AIの品質管理ガイドラインを策定した。

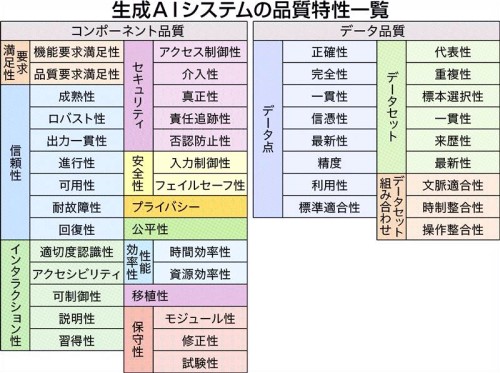

ガイドラインでは品質管理の方法論に沿ってAIシステムが押さえるべき項目を一覧化し手続きを整理した。例えばシステムの信頼性は成熟性やロバスト性(堅牢性)など、インタラクション性は適切度認識性やアクセシビリティーなどから構成される。言葉を定義し、企業の品質保証部門がAIシステムを検証できるようにした。

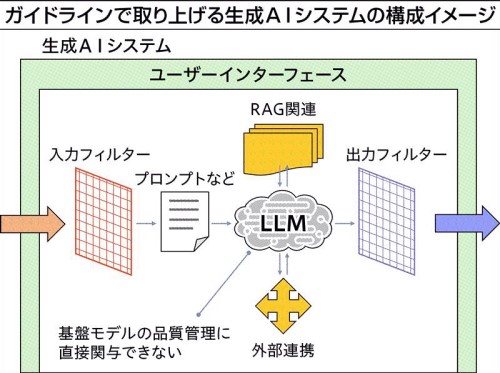

日本の事業者は自社で基盤モデルを構築するよりも海外製の巨大な基盤モデルを調達してシステムに組み込むことが多い。そのため基盤モデル自体はブラックボックスであっても周辺のシステムで不適切な出力を抑える。

この第一歩として用途を明確にする。小西弘一総括研究主幹は「必要な性能や品質は目的に応じて決まる」と説明する。例えば人事選考にAIを用いる際には公平性が求められる。性別や出身、学歴など、どんな項目に配慮するか。また学習データに必要な分布や代表性などを検討する。大岩寛副研究部門長は「議論を掘り下げやすくした。実用ではAIの限界を明確にして人が補って使うことが多い」と指摘する。

生成AIシステムの要件定義には丁寧な検討が求められる。エキスパートシステムで開発者が多様な知識を定式化したように、生成AIでは品質保証部門が多様な観点で検討して誤用を防ぐ必要がある。こうした人材を育成するため、大岩副研究部門長らは新エネルギー・産業技術総合開発機構(NEDO)の特別講座などで企業向けにAI品質マネジメントを教えている。人材の厚みを増やし、AIの普及を支えていく。

日刊工業新聞 2025年07月08日

出典:ニュースイッチ Newswitch by 日刊工業新聞社

Kodera Takayuki 編集局科学技術部 記者

エキスパートシステムのころは開発側があらゆる知識を書き下さないといけませんでした。生成AIになって品質保証やユーザー側にあらゆる状況を書き下す仕事が移行しているように思います。あらゆる全部を書き下す。こんなことはできないので用途を定めて使い方を限定します。使い方が決まれば洗い出せる。そうすると、品質管理の知見を束ねて学習させれば、みんなが楽になるように思います。アライメントも規模の論理が効くのか、ニッチな用途もきっちり押さえていく品質管理アプローチが有効なのか。現在はインテグレーターやサービサーが責任を負って作り込んでいますが、どこかで逆転することを想定しながら進めることになると思います。